Meta publikuje Llama 4

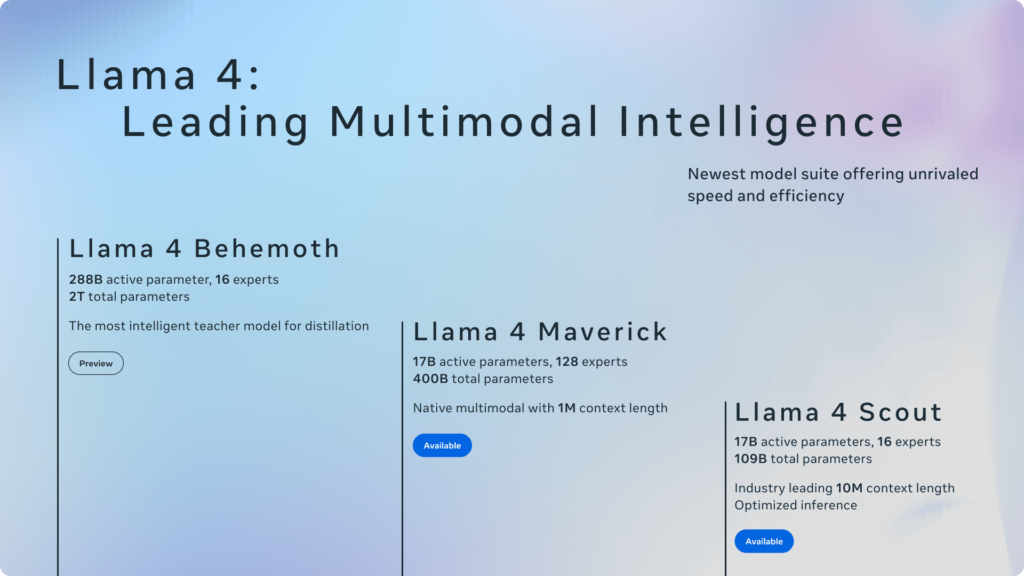

Meta AI dokonało kolejnego przełomu w rozwoju sztucznej inteligencji, prezentując model Llama 4 – zaawansowany system wielomodalny, który może przetwarzać zarówno tekst, jak i obrazy. Warto podkreślić, że jest to znaczący krok naprzód w ewolucji modeli językowych, a ponadto otwiera on nowe możliwości wykorzystania AI w różnych dziedzinach.

Czym jest Llama 4?

Llama 4 to najnowsza generacja modeli AI od Meta, która wprowadza wielomodalność jako kluczową funkcję. W związku z tym model może nie tylko rozumieć i generować tekst, ale również interpretować obrazy, co w konsekwencji znacząco rozszerza jego możliwości zastosowania w praktyce.

W przeciwieństwie do poprzednich wersji, Llama 4 została stworzona jako model wielomodalny od podstaw, dzięki czemu pozwoliło to na lepszą integrację możliwości rozpoznawania obrazów z przetwarzaniem języka naturalnego. Co więcej, takie podejście umożliwiło osiągnięcie wysokiej spójności między różnymi modalnościami.

Kluczowe funkcje i możliwości

Zaawansowane rozumienie obrazów

Model potrafi analizować obrazy na głębokim poziomie, rozpoznając nie tylko ogólną zawartość, ale również szczegóły, kontekst i relacje między elementami. Ponadto może opisywać sceny, identyfikować obiekty, a nawet interpretować wykresy i diagramy, co stanowi znaczący postęp w porównaniu z poprzednimi wersjami.

Ulepszone zdolności językowe

Llama 4 oferuje znacznie lepsze rozumienie kontekstu, generowanie odpowiedzi i prowadzenie konwersacji niż poprzednie wersje. W rezultacie model może prowadzić bardziej naturalne rozmowy, a jednocześnie lepiej rozumie niuanse i kontekst wypowiedzi. Warto zauważyć, że te ulepszenia przekładają się bezpośrednio na jakość interakcji z użytkownikiem.

Bezpieczeństwo i odpowiedzialność

Meta położyło duży nacisk na kwestie bezpieczeństwa i etycznego wykorzystania AI. Dlatego też Llama 4 została zaprojektowana z myślą o minimalizacji ryzyka generowania szkodliwych treści, dezinformacji czy nieodpowiednich odpowiedzi. Należy podkreślić, że aspekt bezpieczeństwa był jednym z priorytetów podczas rozwoju modelu.

Potencjalne zastosowania

Wielomodalność Llama 4 otwiera drzwi do wielu nowych zastosowań, przy czym warto wymienić najważniejsze z nich:

- Asystenci wizualni – mogą pomagać osobom z wadami wzroku w interpretacji otoczenia, a zatem zwiększają dostępność technologii

- Zaawansowana analiza dokumentów – automatyczne przetwarzanie dokumentów zawierających zarówno tekst, jak i obrazy, co w efekcie przekłada się na oszczędność czasu

- Edukacja – tworzenie interaktywnych materiałów edukacyjnych wykorzystujących wizualizacje, a tym samym wspieranie różnych stylów uczenia się

- E-commerce – lepsze rozumienie i kategoryzowanie produktów na podstawie zdjęć, a więc usprawnienie procesów sprzedażowych

- Medycyna – wspomaganie analizy obrazów medycznych i interpretacji wyników badań, co w konsekwencji może prowadzić do szybszej i dokładniejszej diagnostyki

Dostępność i wdrożenie

Meta udostępnia Llama 4 jako model open-source, co oznacza, że będzie dostępny zarówno dla badaczy, jak i twórców aplikacji. Co istotne, firma kontynuuje strategię rozpoczętą przy poprzednich wersjach Llama, a przez to umożliwia szerszej społeczności rozwijanie i dostosowywanie modelu do różnych zastosowań. Należy zaznaczyć, że taka polityka otwartości sprzyja innowacjom i demokratyzacji dostępu do zaawansowanych technologii AI.

Wyzwania i ograniczenia

Pomimo imponujących możliwości, Llama 4 wciąż zmaga się z pewnymi ograniczeniami, o których warto wspomnieć:

- Interpretacja złożonych, niejednoznacznych obrazów może być wyzwaniem, jednakże trwają prace nad dalszym doskonaleniem tych funkcji

- Model, jak wszystkie duże systemy AI, wymaga znacznych zasobów obliczeniowych, aczkolwiek Meta pracuje nad optymalizacją wydajności

- Istnieje ryzyko błędnych interpretacji w niektórych kontekstach kulturowych lub specjalistycznych, niemniej jednak z każdą iteracją modelu problem ten jest stopniowo niwelowany

Przyszłość wielomodalnej AI

Wprowadzenie Llama 4 jest symptomatyczne dla szerszego trendu w rozwoju sztucznej inteligencji – odchodzenia od systemów jednozadaniowych w kierunku uniwersalnych modeli, które mogą przetwarzać i integrować różne rodzaje danych. Bez wątpienia ta wielomodalność jest kluczowa dla tworzenia bardziej intuicyjnych, użytecznych i wszechstronnych systemów AI.

Meta nie jest jedyną firmą pracującą nad wielomodalnymi systemami AI – podobne wysiłki podejmują również Google (Gemini), OpenAI (GPT-4V), czy Anthropic (Claude). Co ciekawe, ta zdrowa konkurencja napędza innowacje w całej branży, a w rezultacie przyspiesza rozwój technologii AI jako całości. Warto zauważyć, że mimo rywalizacji, firmy te często inspirują się nawzajem, co prowadzi do szybszego postępu.

Co jeszcze wprowadza Meta?

Llama 4 to tylko część szerszej strategii Meta w obszarze sztucznej inteligencji. Firma aktywnie rozwija szereg innych innowacyjnych technologii i narzędzi:

Meta AI – asystent AI dostępny dla wszystkich

Meta wprowadza zaawansowanego asystenta AI zintegrowanego z platformami Facebook, Instagram, WhatsApp i Messenger. Asystent ten, napędzany modelem Llama 4, może odpowiadać na pytania, tworzyć treści i interpretować obrazy. Jest to część strategii demokratyzacji dostępu do zaawansowanych narzędzi AI.

Rozszerzenia AI dla twórców

Meta wdraża nowe narzędzia oparte na AI dla twórców treści na swoich platformach. Narzędzia te pomagają w edycji zdjęć, generowaniu pomysłów na treści i analizie zaangażowania odbiorców.

Infrastruktura AI dla programistów

Firma rozwija również zaawansowaną infrastrukturę i zestawy narzędzi dla programistów, którzy chcą budować własne aplikacje wykorzystujące modele AI. Platforma Meta AI Developer oferuje dostęp do modeli, API i zasobów edukacyjnych.

Badania nad odpowiedzialnym rozwojem AI

Meta inwestuje znaczne środki w badania nad etycznym i odpowiedzialnym rozwojem AI. Firma utworzyła dedykowane zespoły zajmujące się kwestiami bezpieczeństwa, uczciwości i przejrzystości systemów AI.

Llama 4 od Meta reprezentuje znaczący krok naprzód w rozwoju wielomodalnej sztucznej inteligencji. Łącząc zaawansowane przetwarzanie języka naturalnego z możliwościami interpretacji obrazów, model otwiera nowe możliwości zastosowań AI w różnych dziedzinach. Jako system open-source, Llama 4 ma potencjał, by przyspieszyć rozwój innowacyjnych rozwiązań AI dostępnych dla szerokiego grona użytkowników.

Wprowadzenie Llama 4 oraz innych inicjatyw AI podkreśla zaangażowanie Meta w rozwój zaawansowanych systemów sztucznej inteligencji, które są jednocześnie potężne, bezpieczne i dostępne dla społeczności. W miarę jak wielomodalne systemy AI stają się coraz bardziej zaawansowane, możemy spodziewać się kolejnych przełomów, które jeszcze bardziej zbliżą nas do prawdziwie inteligentnych systemów rozumiejących świat w sposób podobny do ludzi.